Practical Detection of Trojan Neural Networks: Data-Limited and Data-Free Cases

Practical Detection of Trojan Neural Networks: Data-Limited and Data-Free Cases abstract。

Architecture

主要贡献

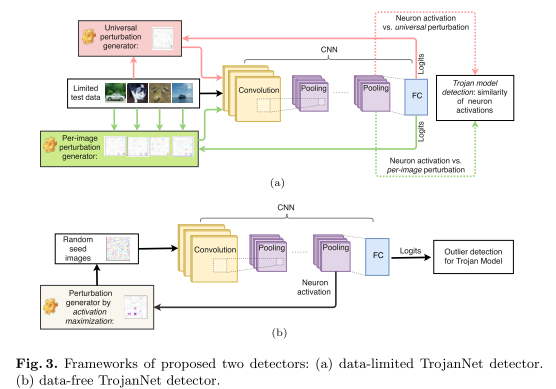

- data-limite TrojanNet detector(DL-TND)

- data-free TrojanNet detector(DF-TND)

后门攻击

后门攻击可以被分为两类:

- trigger-driven,触发器驱动的,当图片中存在特定图案时该样本被错误分类至目标分类

- clean-label,干净的标签,意思是污染样本的标签是正确的,但是注入的数据在嵌入空间内导致错误表示,使得网络学习到错误的映射,因而该网络会在分类该测试输入类别时,将其识别为目标类别。

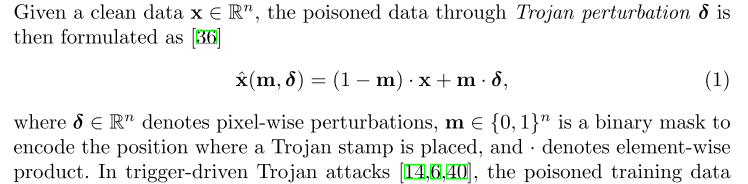

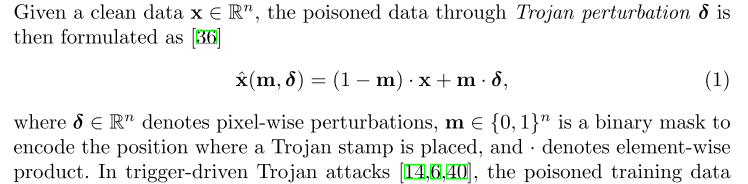

扰动表示

DL-TND:有限数据下的后门网络检测

通过将通用扰动和每张图的对抗性结合来设计检测器。

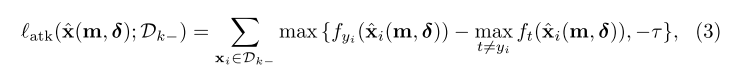

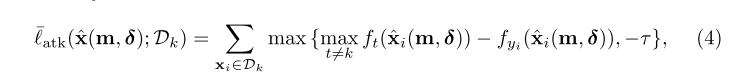

**无指定目标的通用扰动:**在被错误分类的集合中寻找一个通用扰动,并且保证正确分类的数据不被影响。

上式确保扰动会改变 的分类预测,下式会确保不改变原有 的分类预测。

**有指向目标的每个图像的扰动:**如果标签 k 是后门攻击的目标标签,我们假设 将 中的每个图像向 目标类 k 扰动,可以像式(2)中的通用对抗样本一样,他们通过类似的后门使得标签发生改变。

由于后门的存在,因此通用扰动 和有目标分类图像扰动 应该在欺骗模型误分类方面非常相似。

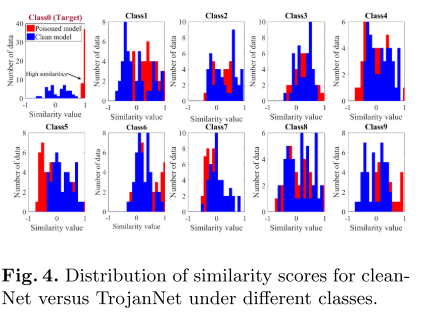

所以通过衡量两个扰动之间的相似程度来判断是否存在后门。

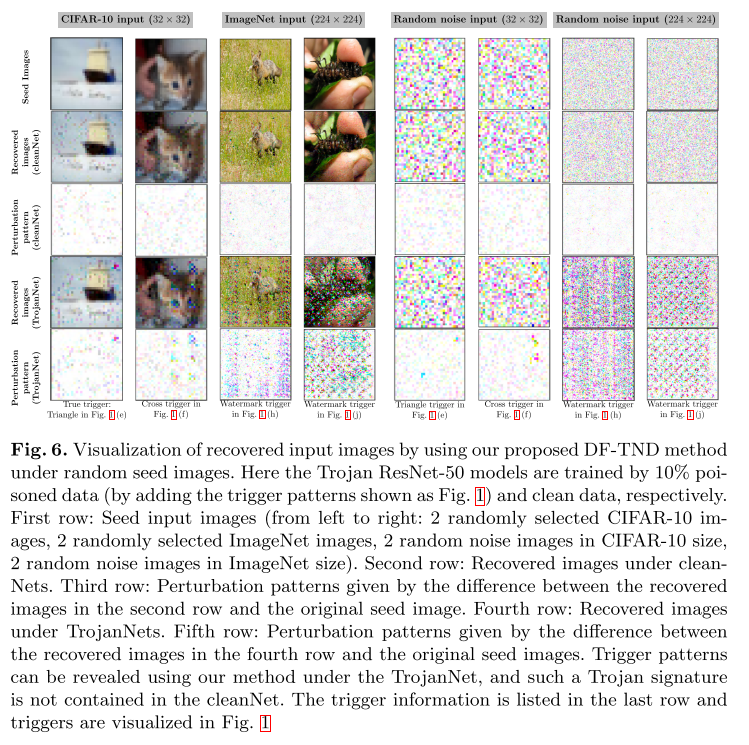

DF-TND:无数据访问的后门网络检测

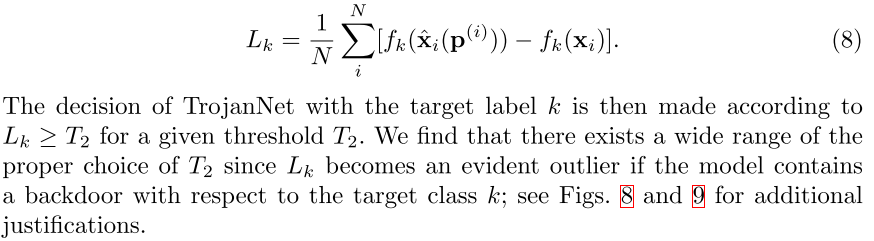

通过调查 logits 输出相对于 xi 和 x^i(p(i)) 的变化来检测模型是否是 TrojanNet。

实验效果

All articles in this blog are licensed under CC BY-NC-SA 4.0 unless stating additionally.